Correction du facteur de puissance (suite)

Définition du facteur de puissance

Pour alléger les notations, on notera FP pour Facteur de Puissance. Le FP est un terme qui décrit les caractéristiques des signaux en entrée d’un appareil électrique utilisant du courant alternatif. Il faut savoir qu’en alternatif, tous les calculs et raisonnements sont plus compliqués qu’en continu car il y a une multitude de facteurs et de nouvelles puissances qui apparaissent.

Globalement, le FP est défini par le rapport entre la puissance active P (en watts) et la puissance apparente S (en voltampères). Il varie entre 0 et 1 et n’a pas d’unité :

La puissance active P est la puissance utile : c’est celle qui produit un travail utile suivant la fonction de l’appareil électrique. Elle se calcule en faisait U*I*cos(phi) en régime sinusoïdal, U étant la tension, I étant le courant (tous les 2 en valeurs efficaces) et phi est le déphasage entre tension et courant. C’est celle que l’on consomme réellement, ce qu’un wattmètre mesure en watts et c’est ce qu’on paye en tant que particulier grâce au compteur de la maison.

La puissance apparente S est celle qui est appelée par l’appareil sur le réseau. Elle se calcule en faisant U*I en valeurs efficaces et s’exprime en Voltampères (VA), attention ce ne sont pas des watts ! Comme son nom le laisse supposer, elle n’est qu’apparente car c’est ce que semble consommer l’appareil vu de l’extérieur. Or, une partie de celle-ci sera non productrice de travail si le PF ne vaut pas 1. Dans ce cas, il y a apparition de ce que l’on appelle la puissance réactive Q à laquelle s’ajoutera une puissance déformante D dans le cas de signaux déformés non sinusoïdaux (à cause des harmoniques encore une fois).

Cette puissance réactive Q n’est en moyenne pas consommée par le système et elle s’exprime en Voltampères réactifs (VAR). Elle se calcule en faisait U*I*sin(phi) en régime sinusoïdal. Elle sert à magnétiser des bobinages par exemple. Elle fait transiter un courant supplémentaire bien réel dont il faut tenir compte dans le dimensionnement des installations électriques. Il en va de même pour la puissance déformante.

Toutes ces puissances sont finalement reliées par cette égalité :

Un système peut très bien appeler 10 A sur le réseau, alors qu’il n’en utilisera réellement que 8 pour produire un travail utile. Le reste sera renvoyé au réseau car le courant est réel et c’est ce qui surcharge ce réseau (+ pertes accrues dans les câbles). C’est pour cela qu’on n’utilise pas la simple formule P=U*I en alternatif car la puissance n’est pas forcément consommée. La formule est fausse et surévalue la consommation réelle dans des systèmes à courant alternatif. Ces systèmes ne sont plus simplement résistifs, mais également capacitifs (condensateur) ou inductifs (bobinage), donc complexes au final. Un appareil qui absorbe une puissance apparente de 500 VA ne consommera que 250 W si son PF vaut 0.5, et non pas 500 W.

Par exemple, le fournisseur d’électricité (EDF) impose à ses clients d’avoir un facteur de puissance minimum car s’il est trop faible, le courant appelé est bien plus grand que nécessaire et on diminue la capacité de ses installations électriques. En effet, ses transformateurs sont définis pour une puissante apparente en VA, pas pour une puissance active en watts ! Si on génère beaucoup de puissance réactive, on diminue la capacité des transformateurs à fournir une puissance active (utile). S’ils autorisaient les petits facteurs de puissance, EDF devrait surdimensionner tout son réseau, ce qui est bien sûr hors de question pour des raisons évidentes de coût. Sans parler que les pertes augmenteraient aussi, et elles sont déjà assez élevées comme ça…

Par exemple, le fournisseur d’électricité (EDF) impose à ses clients d’avoir un facteur de puissance minimum car s’il est trop faible, le courant appelé est bien plus grand que nécessaire et on diminue la capacité de ses installations électriques. En effet, ses transformateurs sont définis pour une puissante apparente en VA, pas pour une puissance active en watts ! Si on génère beaucoup de puissance réactive, on diminue la capacité des transformateurs à fournir une puissance active (utile). S’ils autorisaient les petits facteurs de puissance, EDF devrait surdimensionner tout son réseau, ce qui est bien sûr hors de question pour des raisons évidentes de coût. Sans parler que les pertes augmenteraient aussi, et elles sont déjà assez élevées comme ça…

Pour un particulier, avoir un facteur de puissance proche de 1, ou non, ne changera pas sa facture puisqu’il ne paye pas la puissance réactive. Néanmoins, si EDF a besoin de renforcer son réseau, c’est votre argent qui va servir à cela indirectement car le coût de l’électricité aura surement grimpé… Avec un grand FP, on utilise mieux le réseau et on fait plaisir en même temps à EDF en consommant mieux, pas moins.

C’est pour ça aussi que les industriels par exemple, qui utilisent des machines avec de gros moteurs développant beaucoup de puissance réactive, sont obligés de relever leur facteur de puissance global. Ils peuvent le faire grâce à des batteries de condensateurs montés sur l’arrivée du courant pour tenter de neutraliser le déphasage généré par les machines de production. Il y a des pénalités pour ceux qui tirent trop de puissance réactive car les courants deviennent élevés et le réseau s’en trouve surchargé. Ils sont d’ailleurs facturés sur les 2 puissances à la fois (active et réactive) vu les puissances en jeu, contrairement aux particuliers.

Prenons un autre exemple qui fera assez bien comprendre le phénomène. Si vous disposez d’un onduleur, vous aurez remarqué qu’il est aussi défini pour tenir une certaine puissance apparente en VA. On oublie l’écran pour l’exemple et l’on suppose, lors d’une coupure de courant, que vous teniez 10 min avec l’ordinateur allumé (150 W) qui comporte une alimentation avec un FP égal à 1 (PFC actif). Maintenant, vous changez juste l’alimentation pour en mettre une d’exactement même rendement, mais avec un FP égal à 0.6 (sans PFC). Cette configuration vous permettra de tenir seulement ~6 minutes alors que votre ordinateur consomme exactement la même puissance utile qu’avant. A cause des harmoniques et du déphasage, il y a eu apparition de puissance réactive et déformante à cause du petit FP, donc un courant plus élevé est tiré de l’onduleur, ce qui décharge plus vite la batterie pour rien…

Ce que l’on souhaite avec un PFC, c’est donc d’annihiler la puissance réactive Q générée par le déphasage et la puissance déformante D générée par les harmoniques afin d’avoir puissance apparente = puissance active. On limite alors le transport du courant au strict minimum et on maximise l’efficacité du transport d’énergie.

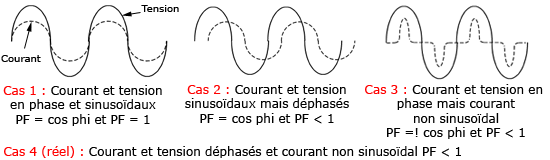

Il faut faire attention car il y a souvent confusion entre ce que l’on appelle le cos phi et le facteur de puissance, ça n’est pas la même chose. Le seul cas très exceptionnel où FP = cos phi, c’est quand la tension et le courant tirés du réseau sont purement sinusoïdaux, autrement dit jamais (il y a toujours déformation, même minime). Voici les différences avec les 4 cas possibles :

cas 1 : c’est celui vers lequel on veut tendre avec un PFC. C’est celui qu’on obtient si l’on branche une résistance pure sur le réseau, elle n’engendre aucune déformation ni déphasage (avance ou retard du courant sur la tension).

cas 2 : c’est celui obtenu quand la charge est purement inductive, elle ne déforme pas le courant, mais elle le retarde de 90°. Dans le cas d’une charge purement capacitive, le courant sera aussi non déformé, mais en avance sur la tension cette fois de 90°.

cas 3 : c’est un cas rare où le courant est très déformé, mais il reste en phase avec la tension. On a donc cos phi=1 car les 2 fondamentaux sont en phase, mais FP est inférieur à 1 à cause de la déformation du courant.

cas 4 : c’est le mélange des cas 2 et 3 (non représenté). Le courant est à la fois déformé et déphasé, dans un sens ou dans l’autre, par rapport à la tension. C’est ce qu’on obtient avec une alimentation sans PFC et plus globalement avec un système réel (non linéaire).

Le cos phi, aussi appelé facteur de déplacement, représente le décalage (-90°

Kd est le facteur de distorsion, il varie entre 0 et 1. Il se calcule avec le taux de distorsion harmonique global (THD) qui définit globalement la déformation d’un signal sinusoïdal. Kthêta est le facteur de déphasage entre le fondamental du courant et la tension et il varie aussi entre 0 et 1. Le but est de maximiser les 2 à la fois pour tendre vers PF = 1. Comme les harmoniques sont directement rattachées au facteur de puissance, la norme a imposé des limites à respecter sur leurs niveaux.